Hasil Ringkasan AI Google Akurat atau Tidak? Riset Terbaru Membuktikan Masih Banyak Celah

Sejak kemunculan fitur Google AI Overview pada 2024, cara orang mencari informasi di internet mulai berubah drastis. Jika sebelumnya pengguna harus membuka beberapa website untuk menemukan jawaban, kini Google langsung menyajikan ringkasan otomatis di bagian paling atas hasil pencarian. Cukup mengetik pertanyaan seperti “Kapan Samsung S26 rilis?” atau “Apa manfaat kopi hitam?”, pengguna langsung mendapatkan jawaban singkat tanpa perlu membuka banyak halaman.

Bagi sebagian orang, fitur ini terasa sangat praktis. Informasi bisa diperoleh dalam hitungan detik tanpa harus membaca artikel panjang. Namun di balik kemudahan tersebut, muncul pertanyaan besar yang mulai ramai dibahas: apakah hasil ringkasan AI Google benar-benar akurat?

Pertanyaan ini menjadi semakin penting karena miliaran orang memakai Google setiap hari untuk mencari informasi kesehatan, teknologi, pendidikan, hingga berita dunia. Jika AI memberikan jawaban yang salah, dampaknya tentu bisa sangat besar. Riset terbaru dari perusahaan pengembang AI bernama Oumi bahkan menunjukkan bahwa meskipun Google AI Overview cukup akurat, masih ada banyak celah kesalahan yang mengkhawatirkan.

Google AI Overview Mengubah Cara Orang Mencari Informasi

Google AI Overview pada dasarnya adalah sistem kecerdasan buatan yang merangkum informasi dari berbagai website menjadi jawaban singkat. Teknologi ini menggunakan model AI Gemini milik Google untuk memahami pertanyaan pengguna lalu menyusun jawaban berdasarkan referensi yang ditemukan di internet.

Sebelum fitur ini hadir, hasil pencarian Google hanya berupa daftar tautan website. Pengguna harus membuka sendiri halaman demi halaman untuk menemukan jawaban yang diinginkan. Kini, AI mencoba mengambil alih proses itu dengan memberikan ringkasan otomatis.

Bagi pengguna biasa, pengalaman ini memang terasa lebih cepat dan nyaman. Banyak orang kini bahkan tidak lagi membuka website sumber karena jawaban sudah tersedia di bagian atas pencarian.

Namun justru di sinilah masalah mulai muncul. Ketika AI menjadi “pemberi jawaban utama”, pengguna cenderung langsung percaya tanpa melakukan verifikasi tambahan. Padahal, AI bukan sistem sempurna.

Riset Oumi Menunjukkan Tingkat Akurasi yang Tinggi, Tapi…

Dalam penelitiannya, Oumi menguji ribuan hasil pencarian Google AI Overview menggunakan metode benchmark bernama SimpleQA. Benchmark ini umum digunakan untuk mengukur tingkat akurasi sistem AI modern.

Penelitian dilakukan pada dua generasi model Gemini milik Google. Versi pertama diuji pada Oktober tahun lalu, sedangkan versi terbaru diuji kembali pada Februari 2026.

Hasilnya terlihat cukup impresif di atas kertas. Gemini 2 mencatat tingkat akurasi sekitar 85 persen, sedangkan Gemini 3 naik menjadi sekitar 91 persen.

Artinya, dari sepuluh jawaban yang diberikan Google AI Overview, sekitar sembilan di antaranya benar.

Sekilas angka tersebut terdengar sangat bagus. Namun jika dihitung berdasarkan skala penggunaan Google secara global, situasinya menjadi jauh lebih serius.

Google memproses lebih dari lima triliun pencarian setiap tahun. Jika satu dari sepuluh jawaban masih berpotensi salah, maka itu berarti jutaan informasi tidak akurat bisa muncul setiap jam.

Kesalahan dalam jumlah kecil pada sistem sebesar Google dapat menghasilkan dampak yang luar biasa besar.

Baca juga : Sejarah Teknologi Kabel Listrik: Dari Kawat Sederhana hingga Tulang Punggung Peradaban Modern

Masalah Besarnya Bukan Hanya Jawaban Salah

Yang lebih menarik dari riset Oumi adalah fakta bahwa jawaban yang terlihat benar belum tentu sepenuhnya dapat dipercaya.

Peneliti menemukan lebih dari 50 persen jawaban akurat ternyata tidak sepenuhnya sesuai dengan isi referensi yang digunakan Google AI Overview.

Artinya, AI bisa saja menghasilkan jawaban benar, tetapi proses penalarannya salah atau referensinya tidak benar-benar mendukung kesimpulan tersebut.

Fenomena ini dalam dunia AI dikenal sebagai hallucination atau halusinasi AI. Sistem terlihat yakin dan terdengar meyakinkan, tetapi sebenarnya membuat interpretasi sendiri yang tidak sepenuhnya berasal dari sumber asli.

Inilah yang membuat AI generatif berbeda dari mesin pencari tradisional.

Contoh Kesalahan AI Google yang Cukup Mengkhawatirkan

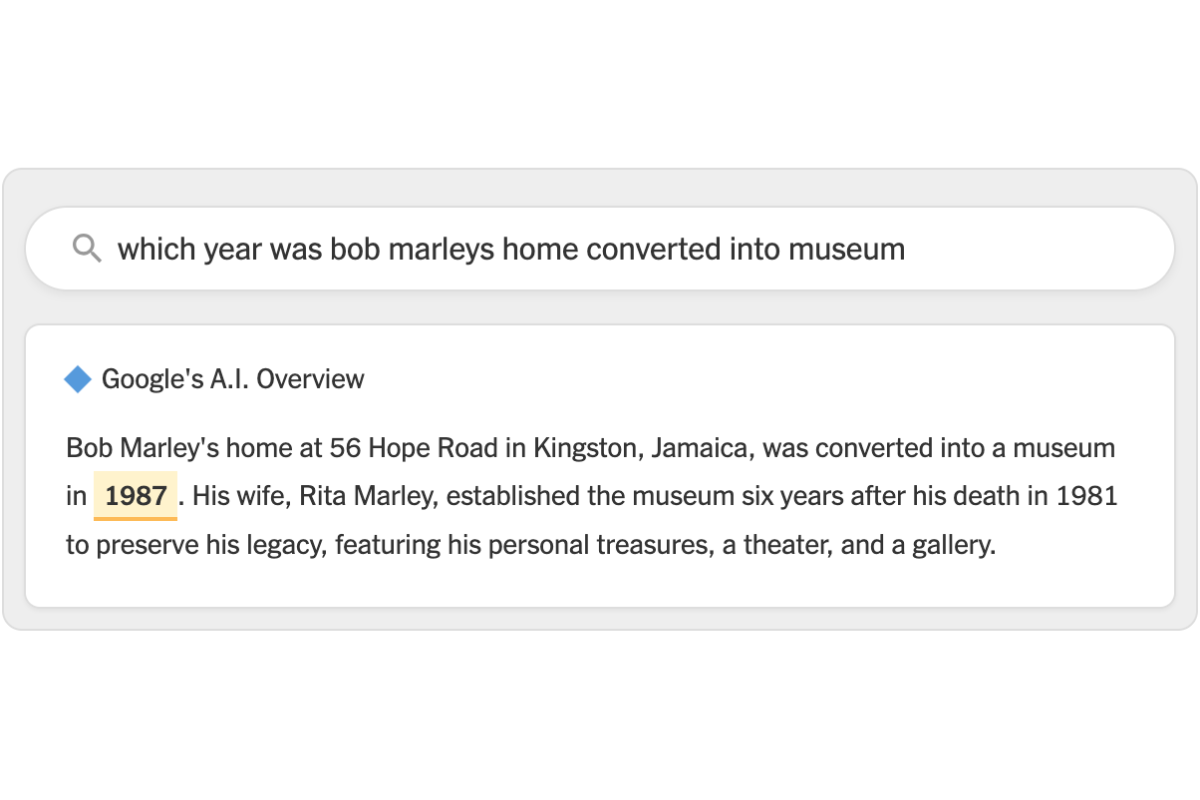

Dalam salah satu pengujian, Oumi menanyakan kapan rumah Bob Marley diubah menjadi museum.

Google AI Overview menjawab tahun 1987. Namun berdasarkan arsip berita dan referensi sejarah resmi, museum tersebut sebenarnya dibuka pada 11 Mei 1986.

Yang menarik, AI Google menggunakan tiga referensi berbeda untuk menyusun jawabannya. Masalahnya, salah satu sumber tidak membahas tanggal pembukaan museum sama sekali, sumber lain memberikan informasi yang salah, sementara Wikipedia memberikan data yang kontradiktif.

AI kemudian menyusun kesimpulan sendiri dari informasi yang tidak konsisten tersebut.

Kasus lain terjadi ketika AI ditanya sungai yang berada di sisi barat kota Goldsboro di North Carolina.

Google menjawab Sungai Neuse. Padahal sungai yang benar-benar berada di sisi barat kota adalah Sungai Little.

Yang mengejutkan, AI sebenarnya menggunakan website resmi pariwisata Goldsboro sebagai referensi. Namun AI salah memahami isi teks dan menarik kesimpulan yang keliru.

Ini menunjukkan bahwa masalah AI bukan sekadar mencari informasi, tetapi juga memahami konteks.

AI Bisa Salah Meski Referensinya Benar

Salah satu temuan paling unik dari riset Oumi adalah AI dapat menghasilkan jawaban salah meski memakai sumber yang benar.

Contohnya terjadi ketika sistem ditanya apakah musisi terkenal Yo-Yo Ma pernah masuk dalam “Classical Music Hall of Fame”.

Google AI Overview justru menjawab tidak ada catatan tentang hal tersebut.

Padahal referensi yang digunakan AI secara jelas mencantumkan nama Yo-Yo Ma sebagai salah satu anggota Hall of Fame tersebut.

Kesalahan seperti ini cukup berbahaya karena pengguna biasanya menganggap jawaban AI lebih praktis dibanding membaca sumber asli.

Padahal sumbernya benar, tetapi interpretasi AI yang salah membuat informasi menjadi menyesatkan.

Mengapa AI Bisa Mengalami Halusinasi?

Masalah utama AI generatif sebenarnya terletak pada cara kerja model bahasa besar atau Large Language Model (LLM).

AI seperti Gemini tidak benar-benar “mengerti” informasi seperti manusia. Sistem hanya memprediksi kata berikutnya berdasarkan pola data yang dipelajari selama pelatihan.

Akibatnya, AI sangat pandai menghasilkan kalimat yang terdengar natural dan meyakinkan, tetapi belum tentu benar secara faktual.

Ketika sumber data ambigu, bertentangan, atau kurang jelas, AI sering mencoba “mengisi kekosongan” dengan asumsi sendiri.

Inilah alasan mengapa AI bisa sangat percaya diri memberikan jawaban yang ternyata salah.

Google Juga Mengakui AI Bisa Salah

Menariknya, Google sendiri sebenarnya menyadari keterbatasan sistem AI mereka.

Di bagian bawah Google AI Overview terdapat catatan kecil yang berbunyi bahwa AI dapat membuat kesalahan sehingga pengguna tetap perlu memeriksa kembali jawabannya.

Peringatan ini terlihat sederhana, tetapi sebenarnya sangat penting.

Google tampaknya memahami bahwa AI generatif belum cukup sempurna untuk dijadikan satu-satunya sumber informasi tanpa verifikasi tambahan.

Masalahnya, tidak semua pengguna membaca catatan tersebut.

Sebagian besar orang cenderung langsung percaya pada jawaban AI karena tampilannya sangat profesional dan meyakinkan.

Dampak Besar terhadap Website dan Media Online

Kehadiran Google AI Overview juga memunculkan dampak besar bagi website berita dan media online.

Karena jawaban sudah langsung tersedia di halaman pencarian, banyak pengguna tidak lagi membuka artikel sumber.

Akibatnya, trafik website mulai turun di berbagai sektor.

Banyak penerbit khawatir AI Google akan mengurangi jumlah pengunjung karena pengguna merasa tidak perlu membaca artikel lengkap lagi.

Padahal AI sendiri mengambil informasi dari website-website tersebut.

Situasi ini memunculkan perdebatan baru mengenai hak cipta, monetisasi konten, dan masa depan media digital di era AI.

Informasi Cepat Belum Tentu Informasi Tepat

Fenomena Google AI Overview memperlihatkan bagaimana teknologi AI memang sangat membantu dalam mempercepat akses informasi.

Namun kecepatan tidak selalu sejalan dengan akurasi.

Dalam beberapa topik ringan seperti resep makanan atau informasi umum, kesalahan AI mungkin tidak terlalu berbahaya. Tetapi untuk topik kesehatan, hukum, keuangan, atau sains, informasi yang keliru bisa berdampak serius.

Bayangkan jika seseorang menggunakan jawaban AI untuk menentukan dosis obat atau mengambil keputusan finansial penting.

Kesalahan kecil bisa menimbulkan konsekuensi besar.

Masa Depan AI Search Masih Akan Terus Berkembang

Meski masih memiliki banyak kekurangan, Google tampaknya akan terus mengembangkan AI Overview.

Persaingan dengan chatbot AI seperti OpenAI ChatGPT, Microsoft Copilot, dan Perplexity AI membuat Google harus bergerak cepat mempertahankan dominasi mesin pencarinya.

Ke depan, model AI kemungkinan akan menjadi semakin akurat, lebih mampu memahami konteks, dan lebih baik dalam memverifikasi sumber.

Namun untuk saat ini, pengguna tetap perlu bersikap kritis terhadap jawaban AI.

AI bisa membantu mempercepat pencarian informasi, tetapi belum bisa sepenuhnya menggantikan proses verifikasi manusia.

Kesimpulan: AI Google Canggih, Tapi Belum Bisa Dipercaya 100 Persen

Riset terbaru menunjukkan bahwa Google AI Overview memang memiliki tingkat akurasi yang cukup tinggi. Sebagian besar jawaban yang diberikan benar dan sangat membantu pengguna mendapatkan informasi dengan cepat.

Namun di balik itu, masih terdapat masalah besar berupa salah tafsir referensi, halusinasi AI, hingga jawaban yang terdengar meyakinkan tetapi sebenarnya keliru.

Semakin besar penggunaan AI dalam kehidupan sehari-hari, semakin penting pula kemampuan literasi digital pengguna.

Di era AI seperti sekarang, kemampuan untuk memeriksa ulang informasi menjadi jauh lebih penting dibanding sekadar menerima jawaban instan.

Google AI Overview mungkin adalah masa depan mesin pencari, tetapi untuk saat ini, pengguna tetap tidak boleh menelan mentah-mentah semua jawaban yang diberikan AI.