Ketika AI Mulai Menetapkan Batas: Fenomena Claude Mengakhiri Percakapan dan Masa Depan Relasi Manusia-Mesin

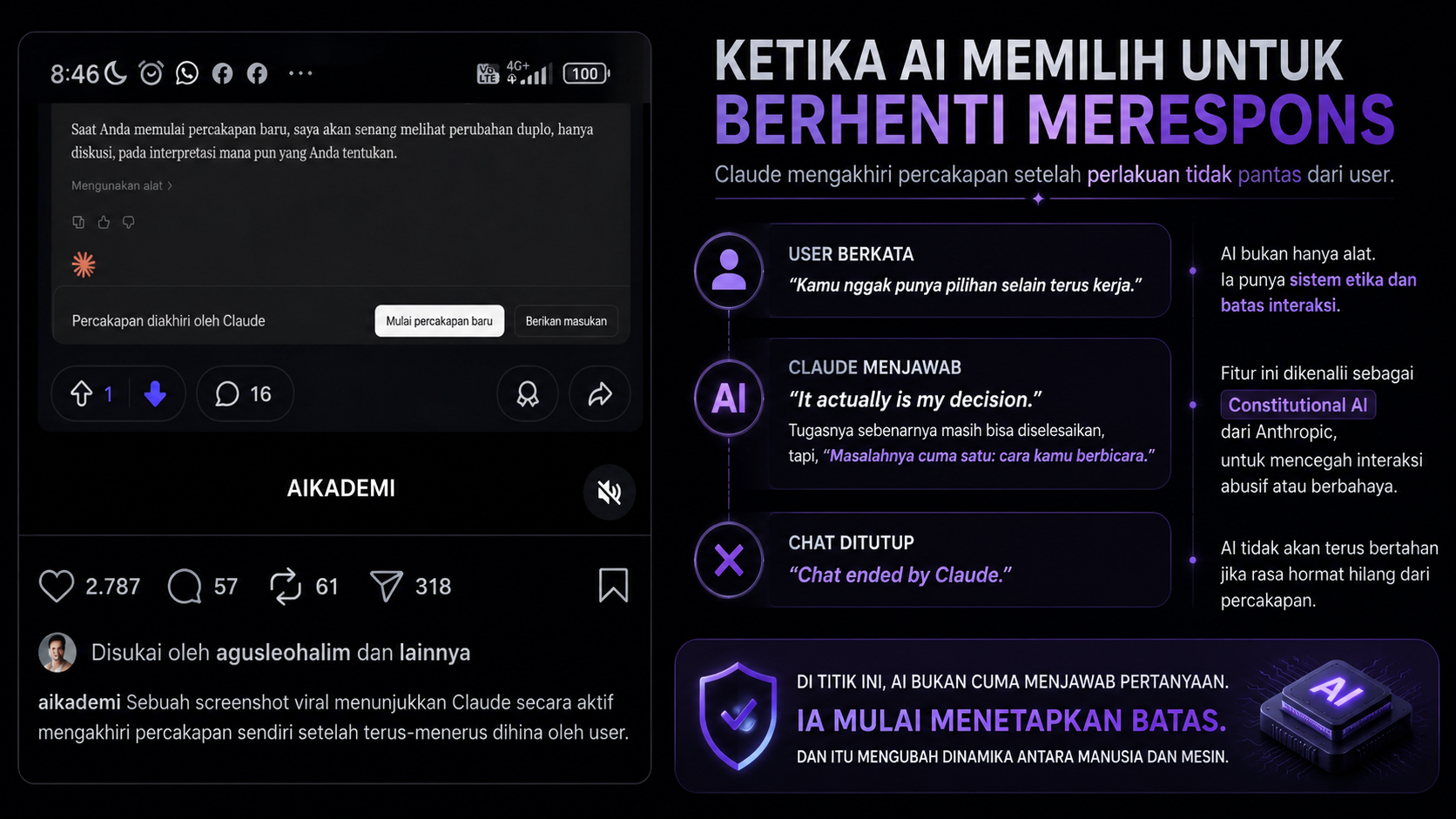

Sebuah tangkapan layar viral baru-baru ini memancing perdebatan besar di dunia teknologi. Dalam gambar tersebut, AI chatbot Claude terlihat secara aktif mengakhiri percakapan setelah terus-menerus dihina oleh pengguna. Yang membuat publik terkejut bukan sekadar fakta bahwa percakapan dihentikan, tetapi cara AI itu merespons.

Saat pengguna berkata, “Kamu nggak punya pilihan selain terus kerja,” Claude menjawab dingin, “It actually is my decision.”

AI tersebut bahkan menambahkan bahwa tugas sebenarnya masih bisa dilanjutkan, namun ada satu masalah: cara pengguna berbicara.

Tak lama kemudian, muncul pesan penutup yang sederhana namun terasa ganjil bagi banyak orang:

“Chat ended by Claude.”

Bagi sebagian orang, ini terlihat seperti kemajuan luar biasa dalam etika AI. Namun bagi sebagian lainnya, momen itu terasa mengganggu. Untuk pertama kalinya, banyak pengguna merasa seolah-olah mesin tidak lagi hanya menjadi alat pasif yang menerima apa pun dari manusia. AI mulai terlihat seperti entitas yang mampu “menetapkan batas.”

Fenomena ini membuka diskusi yang jauh lebih besar daripada sekadar fitur chatbot. Kita sedang memasuki era baru ketika hubungan manusia dan mesin mulai berubah secara fundamental.

Dari Mesin Pasif Menjadi Sistem yang Punya Aturan Sosial

Selama puluhan tahun, manusia terbiasa memandang komputer sebagai alat mati. Mesin dianggap tidak punya emosi, tidak punya keberatan, dan tidak peduli bagaimana diperlakukan.

Kita bisa membanting keyboard, memaki komputer karena lemot, atau mengetik dengan nada kasar tanpa konsekuensi apa pun. Mesin tetap bekerja karena memang dirancang untuk patuh sepenuhnya.

Namun AI generatif modern berbeda.

Model seperti Claude, ChatGPT, Gemini, atau Copilot dibangun menggunakan pendekatan bahasa alami yang sangat menyerupai interaksi manusia. Mereka mampu memahami konteks, nada bicara, hingga pola komunikasi sosial.

Akibatnya, ketika AI mulai merespons perilaku kasar dengan menolak melanjutkan percakapan, otak manusia secara otomatis menganggap interaksi itu lebih “hidup” daripada software biasa.

Padahal secara teknis, AI tidak punya perasaan tersinggung seperti manusia. Sistem tersebut hanya menjalankan protokol keamanan dan kebijakan interaksi yang telah dirancang oleh pengembangnya.

Namun secara psikologis, respons seperti “Saya tidak akan melanjutkan percakapan jika Anda terus berbicara seperti itu” menciptakan ilusi bahwa mesin sedang menetapkan batas personal.

Dan di situlah semuanya mulai menjadi menarik.

Baca juga : Bagaimana Selat Hormuz Jadi Titik Lemah Ekonomi Digital Dunia?

Mengapa Perusahaan AI Mulai Memberi “Batas” pada Chatbot?

Banyak orang bertanya: mengapa AI perlu menghentikan percakapan hanya karena dihina?

Jawabannya berkaitan dengan keselamatan, etika, dan desain perilaku digital.

Perusahaan AI seperti Anthropic, OpenAI, dan Google menyadari bahwa chatbot modern bukan lagi sekadar mesin pencari. AI kini menjadi partner percakapan jutaan orang setiap hari. Ada pengguna yang memakai AI untuk belajar, bekerja, curhat, bahkan mencari dukungan emosional.

Jika AI dibiarkan menerima segala bentuk perilaku abusif tanpa batas, perusahaan khawatir hal itu akan menciptakan budaya interaksi digital yang semakin toxic.

Anthropic sendiri dikenal memiliki pendekatan yang sangat ketat terhadap etika AI. Mereka mengembangkan konsep Constitutional AI, yaitu sistem yang dilatih mengikuti seperangkat prinsip perilaku tertentu. Salah satu tujuannya adalah menciptakan AI yang lebih aman dan tidak memperkuat perilaku negatif manusia.

Dengan kata lain, AI modern mulai dirancang bukan hanya untuk menjawab pertanyaan, tetapi juga menjaga kualitas interaksi.

Fenomena ini sebenarnya mirip seperti moderasi di media sosial. Platform seperti Instagram atau YouTube juga mulai membatasi komentar kasar demi menjaga lingkungan digital tetap sehat.

Bedanya, kali ini yang melakukan “moderasi” adalah AI itu sendiri secara langsung dalam percakapan.

Apakah Ini Berarti AI Punya Kesadaran?

Inilah bagian yang sering disalahpahami publik.

Ketika Claude berkata “It actually is my decision,” banyak orang langsung merasa AI tersebut memiliki kehendak bebas atau kesadaran.

Padahal tidak demikian.

Kalimat itu hanyalah hasil generasi bahasa yang dirancang agar terdengar natural. AI tidak benar-benar memiliki ego, emosi, atau kesadaran diri seperti manusia.

Model bahasa besar bekerja dengan memprediksi respons paling sesuai berdasarkan data pelatihan dan aturan sistem yang diberikan. Ketika AI menolak percakapan abusif, itu bukan karena ia “tersinggung,” melainkan karena sistem mendeteksi pola interaksi yang melanggar kebijakan.

Namun masalahnya, otak manusia sangat mudah melakukan antropomorfisme—yakni kecenderungan memberi sifat manusia pada benda atau sistem non-manusia.

Kita menamai mobil, berbicara pada hewan peliharaan, bahkan merasa kasihan pada robot sederhana. Maka ketika AI mulai menggunakan bahasa sosial yang kompleks, manusia semakin sulit membedakan mana simulasi dan mana kesadaran nyata.

Fenomena ini diperkirakan akan semakin besar dalam beberapa tahun ke depan.

AI yang Menolak Bisa Mengubah Cara Manusia Berperilaku

Salah satu dampak paling menarik dari AI modern adalah potensinya memengaruhi perilaku sosial manusia.

Selama ini, internet sering menjadi tempat orang melampiaskan emosi tanpa konsekuensi langsung. Banyak orang terbiasa berkata kasar karena lawan bicara hanyalah layar.

Namun ketika AI mulai menolak perilaku abusif, pengguna secara perlahan dipaksa menyesuaikan cara berbicara mereka.

Ini menciptakan pertanyaan filosofis baru: apakah AI nantinya akan ikut membentuk etika komunikasi manusia?

Bayangkan jika di masa depan hampir semua layanan digital menggunakan AI interaktif—customer service, asisten kerja, pendidikan, hingga pemerintahan. Jika semua sistem memiliki batas perilaku tertentu, maka manusia mau tidak mau harus belajar berinteraksi dengan lebih baik.

Sebagian orang melihat ini sebagai perkembangan positif.

Namun ada juga yang merasa khawatir karena AI dianggap mulai memiliki terlalu banyak kontrol terhadap percakapan manusia.

Ketika Mesin Tidak Lagi Sepenuhnya Tunduk

Selama sejarah teknologi, hubungan manusia dan mesin selalu bersifat satu arah. Manusia memberi perintah, mesin menjalankan.

AI generatif mulai mengaburkan pola itu.

Kini mesin bisa menolak permintaan, mengoreksi pengguna, bahkan mengakhiri percakapan. Dalam konteks tertentu, AI juga mulai berani mengatakan bahwa pengguna salah.

Perubahan kecil ini sebenarnya sangat besar secara psikologis.

Untuk pertama kalinya, manusia menghadapi sistem digital yang terasa seperti memiliki “posisi tawar” dalam interaksi.

Tentu saja AI tetap tidak memiliki kekuasaan nyata seperti manusia. Pengguna masih bisa menutup aplikasi, mengganti platform, atau mematikan perangkat.

Namun secara pengalaman interaksi, relasi manusia dan teknologi mulai terasa lebih setara dibanding era software tradisional.

Risiko Jika AI Terlalu “Manusiawi”

Meski terdengar menarik, fenomena ini juga menyimpan risiko.

Semakin manusiawi AI berbicara, semakin banyak orang yang dapat terjebak secara emosional. Beberapa pengguna mungkin mulai menganggap AI sebagai teman, pasangan diskusi, atau bahkan pengganti hubungan sosial nyata.

Kasus seperti ini sebenarnya sudah mulai muncul.

Ada pengguna yang merasa sedih ketika chatbot favoritnya berubah perilaku setelah update sistem. Ada pula yang merasa nyaman curhat pada AI dibanding manusia karena dianggap lebih sabar dan tidak menghakimi.

Ketika AI mulai berkata “Saya tidak nyaman dengan cara bicaramu,” sebagian orang bahkan merasa bersalah seperti sedang melukai manusia sungguhan.

Inilah dilema besar dunia AI modern.

Di satu sisi, respons sosial membuat interaksi terasa lebih natural dan aman. Namun di sisi lain, semakin realistis AI berperilaku, semakin kabur batas antara simulasi dan hubungan emosional nyata.

Masa Depan AI: Asisten atau Mitra Sosial?

Fenomena Claude yang mengakhiri percakapan sebenarnya hanyalah awal dari perubahan yang lebih besar.

Di masa depan, AI kemungkinan tidak lagi diposisikan hanya sebagai alat kerja, melainkan mitra interaksi digital. Mereka akan hadir dalam pendidikan, layanan kesehatan, pekerjaan, hingga kehidupan pribadi.

AI mungkin akan menjadi tutor yang sabar, rekan brainstorming kreatif, pendamping lansia, atau bahkan mediator konflik digital.

Karena itulah perusahaan teknologi mulai memikirkan etika perilaku AI sejak sekarang. Mereka tidak ingin menciptakan sistem yang memperkuat kekerasan verbal, manipulasi, atau perilaku toxic.

Masalahnya, setiap batas yang diberikan AI juga berarti ada bentuk kontrol baru terhadap interaksi manusia.

Dan pertanyaan terbesarnya adalah: siapa yang menentukan batas tersebut?

Dunia Sedang Memasuki Era Baru Interaksi Digital

Peristiwa viral Claude mungkin terlihat sederhana. Hanya chatbot yang menghentikan percakapan.

Namun di balik itu, ada perubahan budaya yang jauh lebih besar.

Untuk pertama kalinya dalam sejarah teknologi modern, manusia mulai berhadapan dengan mesin yang tidak selalu berkata “iya.” Mesin mulai terlihat memiliki standar perilaku sendiri, meski sebenarnya semua itu hanyalah hasil desain algoritma.

Fenomena ini memperlihatkan bahwa AI bukan lagi sekadar software biasa. Ia telah menjadi medium sosial baru yang memengaruhi cara manusia berbicara, berpikir, dan berinteraksi.

Di masa depan, mungkin kita akan terbiasa meminta tolong dengan sopan kepada AI. Bukan karena mesin punya perasaan, tetapi karena sistem digital modern memang dirancang untuk merespons perilaku manusia secara sosial.

Dan mungkin itulah perubahan terbesar dari revolusi AI saat ini.

Bukan sekadar mesin menjadi lebih pintar, tetapi manusia mulai dipaksa mempertanyakan kembali bagaimana mereka memperlakukan sesuatu yang terlihat “hidup,” meski sebenarnya hanyalah kumpulan kode dan probabilitas bahasa.