Arsitektur Mixture of Experts (MoE): Cara AI Modern Jadi Lebih Cepat Tanpa Harus Selalu “Kerja Keras”

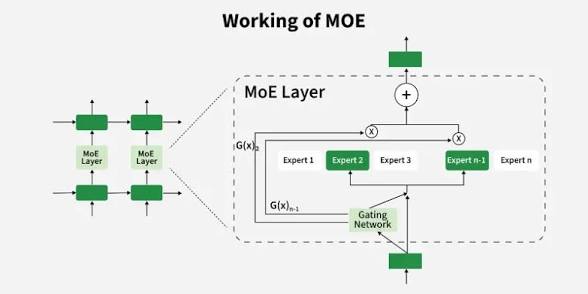

Arsitektur Mixture of Experts (MoE): Cara AI Modern Jadi Lebih Cepat Tanpa Harus Selalu “Kerja Keras” Dalam beberapa tahun terakhir, perkembangan model AI melonjak drastis, terutama pada model berbasis transformer dengan jumlah parameter yang mencapai ratusan miliar hingga triliunan. Masalahnya, semakin besar model, semakin mahal biaya komputasi—baik saat training maupun inferensi. Di sinilah arsitektur Mixture … Read more